在数据驱动的时代,大数据工程师已成为技术领域的明星岗位。但这条成长之路并非坦途,需要扎实的底层功底与灵活的应用能力相结合。本文将从数据处理与存储服务这一核心切入,为你梳理一条从理论到实践、从底层到应用的清晰成长路径,并附上关键的学习路线图。

一、 坚实的地基:底层核心技能

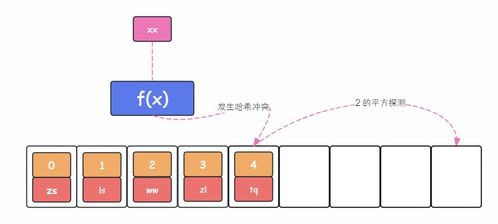

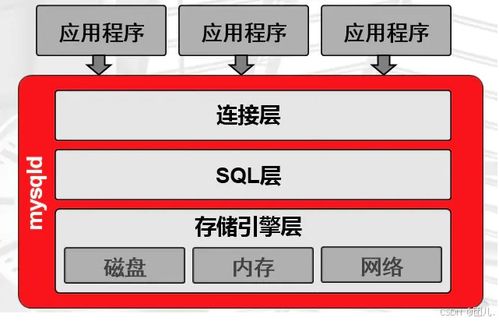

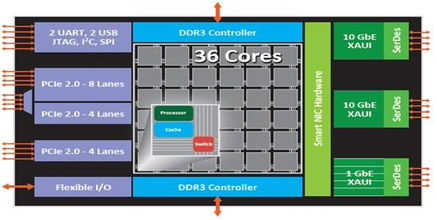

- 计算机科学基础:这是所有技术的根基。必须熟练掌握数据结构(如B树、哈希表、图)、算法(排序、搜索、动态规划)、操作系统(进程/线程管理、内存管理、I/O)和计算机网络(TCP/IP协议栈、HTTP/HTTPS)。理解这些原理,才能更好地驾驭上层的大数据工具。

- Linux与Shell编程:大数据生态几乎都构建在Linux之上。熟练使用Linux命令、进行环境配置、性能监控,并能编写Shell脚本进行自动化运维,是日常工作的基本要求。

- 编程语言:

- Java/Scala:Hadoop生态(HDFS, MapReduce, YARN, HBase)及其多数组件由Java编写,Scala则是Spark的首选语言。深入理解JVM、多线程、网络编程至关重要。

- Python:在数据清洗、分析、机器学习及脚本编写方面不可或缺。需熟悉Pandas、NumPy等库。

二、 核心支柱:大数据处理与存储框架

- 分布式存储基石 - HDFS:深入理解其架构(NameNode, DataNode)、容错机制、读写流程与高可用配置。它是海量数据存储的起点。

- 批处理引擎:

- Hadoop MapReduce:理解其“分而治之”的编程模型(Map, Shuffle, Reduce阶段)是入门经典,有助于理解分布式计算的核心思想。

- Apache Spark:当前批处理与流处理的事实标准。必须精通其核心概念(RDD/DataFrame/Dataset)、执行引擎(DAG调度、内存计算)、性能调优及Spark SQL。

- 流处理引擎:

- Apache Flink:以其高吞吐、低延迟和精确一次(Exactly-Once)语义著称,是现代流处理的首选。需掌握其时间窗口、状态管理、CEP等概念。

- Apache Kafka Streams / Spark Streaming:根据技术栈选型,至少精通其一。

- 数据存储与查询:

- NoSQL数据库:根据场景选择。HBase(列式存储,适用于随机读写),Cassandra(去中心化,高可用写),MongoDB(文档型,灵活模式)。

- 数据仓库:Hive(基于HDFS的SQL引擎,理解其元数据管理与执行引擎),以及云原生或MPP架构的仓库如Apache Doris, ClickHouse, Snowflake等,用于OLAP分析。

- 资源管理与协调:

- YARN:Hadoop生态的资源调度器,理解其组件(ResourceManager, NodeManager)与调度策略。

- Apache ZooKeeper / etcd:分布式协调服务,用于配置管理、命名服务、分布式锁,是许多高可用系统的基石。

三、 上层建筑:数据集成、治理与云服务

- 数据集成与同步:掌握Sqoop(关系型数据库与HDFS/Hive间传输)、Flume(日志采集)、DataX、Canal(增量数据同步)等工具。

- 工作流调度:使用Apache Airflow或DolphinScheduler等工具编排复杂的数据处理任务流,实现自动化。

- 数据治理与质量:了解元数据管理(如Apache Atlas)、数据血缘、数据质量监控体系,确保数据的可信与可用。

- 云原生大数据服务:拥抱云时代。熟悉阿里云MaxCompute/DataWorks、AWS EMR/Redshift/S3、Azure HDInsight/Data Lake等主流云平台的服务,理解其与开源组件的对应关系与优势。

四、 进阶应用:走向数据价值

- 数据湖与湖仓一体:理解数据湖(如Delta Lake, Apache Iceberg, Hudi)的概念,实现数据统一存储与ACID事务,构建湖仓一体架构。

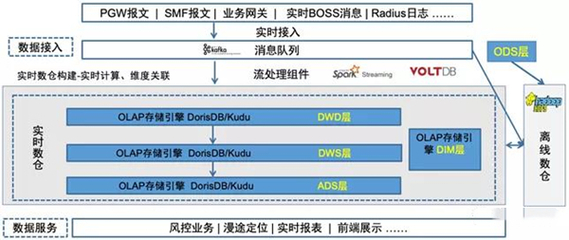

- 实时数仓与数据应用:能够基于Flink/Spark Streaming + Kafka + OLAP数据库(如ClickHouse)构建实时数仓,支撑实时大屏、即席查询等业务。

- 性能调优与故障排查:这是区分普通与资深工程师的关键。需具备集群性能监控(如Prometheus + Grafana)、JVM调优、Shuffle优化、数据倾斜处理、全链路问题诊断的能力。

五、 大数据工程师学习路线图(建议顺序)

`

第一阶段:筑基 (1-3个月)

计算机基础 -> Linux/Shell -> Java核心 -> SQL深入

第二阶段:核心框架入门 (3-6个月)

Hadoop (HDFS, YARN, MapReduce) -> Hive -> Zookeeper -> Spark Core & SQL -> Kafka

第三阶段:纵深与扩展 (4-8个月)

- 存储层:HBase / 一种云数据仓库

- 计算层:Flink (或深入Spark Streaming)

- 调度与集成:Airflow, Sqoop/DataX

- 容器化:Docker, Kubernetes基础

第四阶段:体系化与实战 (持续进行)

- 项目实战:搭建离线/实时数仓项目

- 性能调优:深入JVM、Spark/Flink参数、集群监控

- 架构进阶:学习数据湖、湖仓一体、Lambda/Kappa架构

* 云平台:至少掌握一家主流云的大数据服务套件`

老司机寄语:大数据领域技术迭代迅速,但底层原理和核心思想相对稳定。切忌盲目追逐新工具,而应深入理解分布式系统的核心——如何分而治之、如何保证数据一致性与可用性、如何实现可扩展性。理论学习与动手实践必须双线并行,通过搭建环境、阅读源码、参与项目来不断巩固和深化。保持好奇心与持续学习的能力,是在这条路上行稳致远的不二法门。