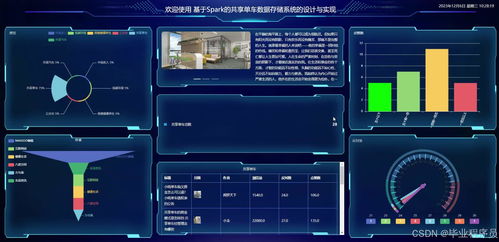

一、项目概述

随着共享单车在城市交通中的普及,产生了海量的骑行数据,包括用户信息、骑行轨迹、车辆状态、订单记录等。这些数据具有体量大、增长快、多样化的特点,传统的关系型数据库难以有效存储和处理。本项目设计并实现了一个基于Python的分布式数据存储与处理系统,利用Hadoop进行海量数据存储,通过Spark进行高效数据处理,并构建可视化大屏进行数据洞察。

二、系统架构设计

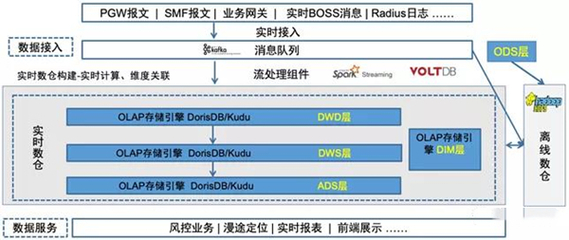

2.1 技术栈

- 数据存储层:Hadoop HDFS(分布式文件系统)

- 数据处理层:Apache Spark(分布式计算框架)

- 编程语言:Python(PySpark)

- 数据采集:Kafka/Flume(实时数据流)

- 可视化层:ECharts/Dash/Flask

- 协调服务:ZooKeeper

- 资源管理:YARN

2.2 架构模块

- 数据采集模块:负责从共享单车APP后端API、GPS设备、物联网传感器等数据源采集数据

- 数据存储模块:将原始数据、清洗后数据、分析结果存储到HDFS中

- 数据处理模块:使用Spark进行数据清洗、转换、分析和建模

- 服务接口模块:提供RESTful API供其他系统调用

- 可视化模块:构建Web大屏展示关键指标

三、核心功能实现

3.1 数据存储设计

`python

# HDFS文件目录结构示例

/sharedbike/

├── rawdata/ # 原始数据

│ ├── gpslogs/ # GPS轨迹日志

│ ├── orderrecords/ # 订单记录

│ └── bikestatus/ # 车辆状态

├── cleaneddata/ # 清洗后数据

├── processeddata/ # 处理分析结果

└── modeldata/ # 模型训练数据`

3.2 数据处理服务

主要实现以下数据处理服务:

1. 数据清洗服务`python

from pyspark.sql import SparkSession

from pyspark.sql.functions import col, when

def cleanbikedata(spark, inputpath, outputpath):

# 读取原始数据

df = spark.read.parquet(input_path)

# 数据清洗

cleaneddf = df.filter(

(col("latitude").isNotNull()) &

(col("longitude").isNotNull()) &

(col("bikeid").isNotNull())

).withColumn(

"duration_minutes",

when(col("duration") > 0, col("duration") / 60).otherwise(0)

)

# 保存清洗后数据

cleaneddf.write.mode("overwrite").parquet(outputpath)

return cleaned_df`

- 数据分析服务

- 热门骑行区域分析

- 骑行高峰时段统计

- 车辆利用率计算

- 用户骑行模式分析

- 异常使用检测

3. 数据存储服务`python

class BikeDataStorage:

def init(self, hdfsurl="hdfs://localhost:9000"):

self.hdfsurl = hdfsurl

def savetohdfs(self, df, path):

"""保存DataFrame到HDFS"""

fullpath = f"{self.hdfsurl}{path}"

df.write.mode("append").parquet(fullpath)

def readfromhdfs(self, path):

"""从HDFS读取数据"""

fullpath = f"{self.hdfsurl}{path}"

return spark.read.parquet(full_path)`

四、可视化大屏实现

4.1 关键技术指标

- 实时监控:在线车辆数、当前订单数、系统健康状态

- 运营分析:日活用户、订单增长率、车辆周转率

- 时空分析:热力图展示骑行分布、时段流量统计

- 预测展示:未来需求预测、车辆调度建议

4.2 大屏界面组件

`python

# 使用Dash构建可视化大屏

import dash

import dashcorecomponents as dcc

import dashhtmlcomponents as html

from dash.dependencies import Input, Output

app = dash.Dash(name)

app.layout = html.Div([

html.H1("共享单车运营监控大屏"),

# 第一行:关键指标

html.Div([

html.Div([

html.H3("在线车辆"),

html.H2(id="online-bikes")

], className="metric-card"),

# 更多指标卡片...

], className="metric-row"),

# 第二行:图表区

html.Div([

dcc.Graph(id="heat-map"),

dcc.Graph(id="time-distribution")

], className="chart-row"),

# 定时刷新

dcc.Interval(id="interval-component", interval=60*1000)

])`

五、系统部署与调试

5.1 环境配置

`bash

# 1. Hadoop集群配置

core-site.xml

hdfs-site.xml

yarn-site.xml

2. Spark配置

spark-env.sh

spark-defaults.conf

3. Python环境

pip install pyspark pandas dash`

5.2 调试策略

- 单元测试:对每个数据处理函数编写测试用例

- 集成测试:测试HDFS读写、Spark作业执行

- 性能测试:大数据量下的处理性能测试

- 日志监控:通过ELK栈收集分析系统日志

5.3 常见问题解决

- 内存不足:调整Spark executor内存配置

- 数据倾斜:使用salting技术或调整partition策略

- HDFS连接失败:检查网络和防火墙设置

- 作业失败:查看YARN日志和Spark UI

六、源码结构与文档

6.1 项目结构

shared-bike-data-system/

├── README.md # 项目说明

├── requirements.txt # 依赖包列表

├── config/ # 配置文件

├── src/ # 源代码

│ ├── data_ingestion/ # 数据采集

│ ├── data_processing/ # 数据处理

│ ├── data_storage/ # 数据存储

│ ├── visualization/ # 可视化

│ └── utils/ # 工具函数

├── tests/ # 测试代码

├── docs/ # 文档

│ ├── design_doc.md # 设计文档

│ ├── api_doc.md # API文档

│ └── deployment_guide.md # 部署指南

└── scripts/ # 部署脚本6.2 核心源码示例

`python

# main.py - 系统主入口

from pyspark.sql import SparkSession

from dataprocessing.cleaner import DataCleaner

from dataprocessing.analyzer import BikeDataAnalyzer

from visualization.dashboard import BikeDashboard

def main():

# 初始化Spark会话

spark = SparkSession.builder \

.appName("SharedBikeDataSystem") \

.config("spark.executor.memory", "4g") \

.getOrCreate()

# 数据清洗

cleaner = DataCleaner(spark)

cleaneddata = cleaner.clean("/sharedbike/raw_data")

# 数据分析

analyzer = BikeDataAnalyzer(spark)

analysisresults = analyzer.analyze(cleaneddata)

# 保存结果

analyzer.saveresults(analysisresults, "/sharedbike/processeddata")

# 启动可视化大屏

dashboard = BikeDashboard(analysis_results)

dashboard.run(host="0.0.0.0", port=8050)

if name == "main":

main()`

七、与展望

本系统成功实现了基于Hadoop和Spark的共享单车数据存储与处理平台,具有以下特点:

- 高可扩展性:分布式架构支持数据量线性增长

- 高性能处理:Spark内存计算大幅提升处理速度

- 完整解决方案:涵盖数据采集、存储、处理、可视化全流程

- 易于维护:模块化设计,清晰的代码结构

未来优化方向:

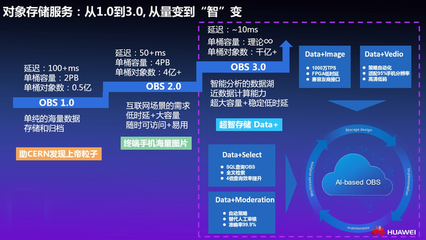

- 引入实时流处理,实现秒级数据更新

- 集成机器学习模型,实现智能调度预测

- 增加多数据源支持,整合天气、交通等外部数据

- 优化可视化大屏,增加交互式分析功能

通过本系统的实施,共享单车运营商可以更好地理解用户行为、优化车辆调度、提升运营效率,为智慧城市建设提供数据支撑。